Comment entraîner un algorithme d’Intelligence Artificielle quand on n’a pas de données ?

C’est une question que se posent beaucoup de Machine Learning Engineers, et à laquelle NVIDIA vient peut-être d’apporter une réponse.

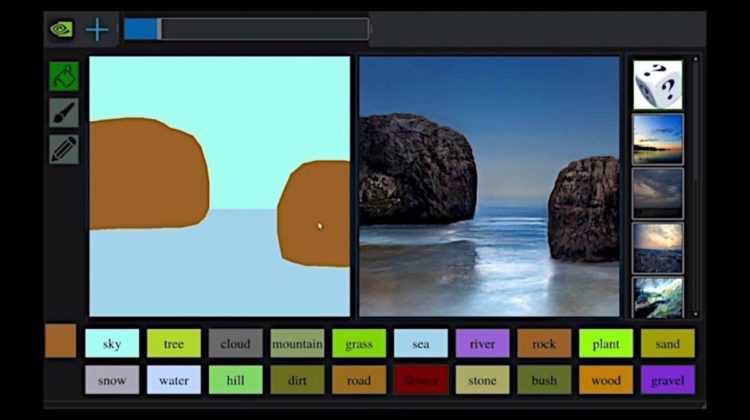

Une équipe de chercheurs de NVIDIA a publié un article il y a quelques jours décrivant une méthode permettant de diviser par un facteur 20 la quantité de données nécessaires pour entraîner un GAN (Generative Adversarial Network), à performances comparables.

Le problème des petits jeux de données est la tendance au surapprentissage (ou overfitting) pour l’algorithme entraîné.

La solution traditionnelle est d’augmenter la taille du jeu de données, ce qui n’est pas toujours possible.

La méthode proposée, baptisée ADA (Adaptive Discriminator Augmentation), consiste à suivre la courbe d’apprentissage du modèle (notée p), et à la limiter lorsque celle-ci augmente trop brutalement, signalant un surapprentissage.

La limite, appelée Discriminator, est capable d’être modulée selon l’avancement de l’entraînement de l’algorithme, et donc d’éviter tout surapprentissage.

Une performance technique, mais quel intérêt ? Entraîner un algorithme avec peu de données labellisées, par exemple des radiographies médicales.

Source : https://proceedings.neurips.cc/paper/2020/file/8d30aa96e72440759f74bd2306c1fa3d-Paper.pdf

Post original : https://www.linkedin.com/posts/guillaumebesson_comment-entra%C3%AEner-un-algorithme-dintelligence-activity-6746691929158778880-_vAx